為什麼選擇 NVIDIA RTX PRO 6000 Blackwell

96GB GDDR7:把整個大型語言模型放進一張卡裡。 對於 LLM 訓練與推論工作負載而言, 顯存容量幾乎決定了你能跑多大的模型、能用多大的 batch size。RTX PRO 6000 Blackwell 的 96GB ECC 記憶體,意味著 70B 等級的模型可以做完整 LoRA 微調、可以在單卡上載入量化後 的更大模型,也讓多並發推論 session 成為可能——不再被 OOM (Out of Memory) 限制工程設計。

Blackwell 架構:AI 工作負載的世代躍進。 第 5 代 Tensor Cores 對 FP8 / FP4 精度提供 原生加速,相較上一代 Ada 架構,訓練吞吐量與推論延遲都有顯著提升。對於要在台灣本地 部署 AI 伺服器、追求極致 TCO 的團隊來說,RTX PRO 6000 的單卡效能讓你用更少的卡達到 更高的產出。

Workstation Edition vs Max-Q:怎麼選?

選 Workstation Edition(600W) 如果你需要單卡極致效能,且機房散熱與電力充足。 適合 AI 訓練工作站、深度學習研究、單卡高並發推論。

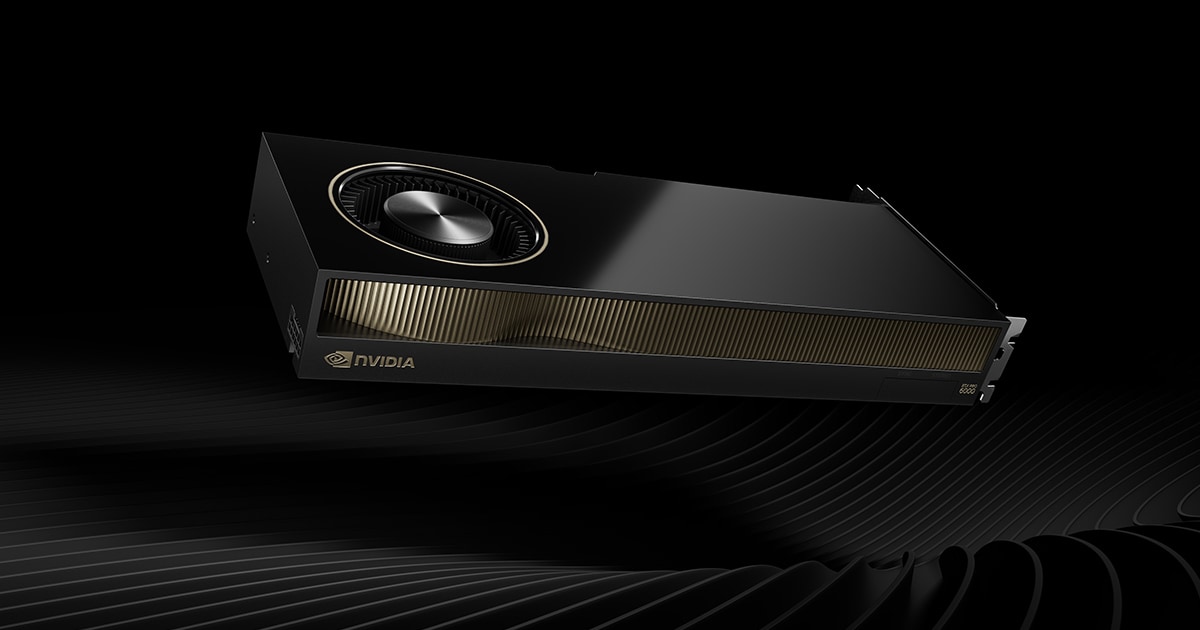

選 Max-Q Edition(300W) 如果你要在工作站機殼裡並排 2 張卡,或者單卡但機殼散熱 不夠。Max-Q 採用鼓風扇設計(直排出風),即使兩張並排也不會互相加熱;功耗減半也讓 電源規格與整機噪音都好應付。

兩款都配備相同的 96GB GDDR7、24,064 CUDA cores 與 752 顆 Tensor Cores—— 核心效能完全一致,差別只在散熱設計與功耗目標。

典型應用場景與細節

96GB 顯存讓以下場景變得可行:

- LLM 微調 (Fine-tuning):可容納 70B 等級模型的 LoRA 訓練,或對中型模型 進行全參數微調

- 推論伺服器:單卡支援多並發推論 session,適合企業內部建置 LLM API Gateway

- 深度學習研究:CV、NLP、多模態模型訓練;多卡擴展可組成中型訓練叢集

- AI 影像 / 影片生成:Stable Diffusion XL、Flux、HunyuanVideo 等模型本地部署

- 企業 AI 工作站:本地化部署、資料不出機房,符合金融、法律、醫療等高合規場景需求

- 3D 渲染與專業視覺化:影視特效、產品設計、科學視覺化等高精度繪圖工作

為什麼向荔枝智慧採購

我們不只是賣卡。荔枝智慧本身就是企業 AI 導入團隊,所以你買卡時 也可以順便聊聊它要用在哪——LLM 客服、文件問答、RAG 知識庫、AI Agent 等地端應用,我們都能協助規劃與上線。

需要詳細報價或 AI 導入諮詢,請來信 support@lychee.tw, 我們會在 2 個工作日內回覆。