RTX PRO 6000 Workstation vs Max-Q:AI 工作站怎麼挑?

NVIDIA RTX PRO 6000 Blackwell 同型號有兩個版本:Workstation Edition(600W) 與 Max-Q Workstation Edition(300W)。兩款都屬於 RTX PRO 6000 Blackwell 系列, 同樣搭載 96GB GDDR7 ECC 記憶體與 1,792 GB/s 記憶體頻寬;但因功耗與時脈設定不同, 官方峰值效能也不同:Workstation 為 600W、FP32 125 TFLOPS;Max-Q 為 300W、 FP32 110 TFLOPS。真正影響採購決策的,是功耗、散熱設計、機殼相容性與多卡擴充。

但這個「只是散熱」的差別,會直接影響你的整機配置、電力規劃、機殼噪音, 甚至能不能擴充到多卡。對於要為 AI 工作負載採購工作站的企業客戶,這個選擇值得 花十分鐘搞清楚。

本文資料來自 Level1Techs(Wendell)的實測影片, 我們依採購決策角度重新整理,並補上台灣市場的配置觀點。

TL;DR:先給你結論

| 你的情境 | 建議版本 |

|---|---|

| 單張卡、極致效能優先 | Workstation 600W |

| 想擺兩張卡進工作站 | Max-Q ×2 |

| LLM 推論 / 微調為主 | Max-Q(效能差距小,省電 50%) |

| Blender / 3D 渲染 / 高密度計算 | Workstation 600W |

| 機殼空間或散熱受限 | Max-Q(鼓風扇直排,多卡不互相加熱) |

| 沒有 1500W+ 工業級 PSU | Max-Q(單卡可用 850W 等級 PSU,仍需評估整機餘裕) |

如果你看完這張表就有答案,可以直接來信詢價。 如果你想知道為什麼,繼續往下看。

規格對照:主要差別在功耗、時脈與散熱

核心 GPU 架構、CUDA / Tensor Core 配置與記憶體配置相同;差別在功耗、時脈與散熱設計, 連帶影響官方峰值效能:

| 項目 | Workstation Edition | Max-Q Workstation Edition |

|---|---|---|

| GPU 架構 | NVIDIA Blackwell | NVIDIA Blackwell |

| CUDA Cores | 24,064 | 24,064 |

| Tensor Cores | 752(第 5 代) | 752(第 5 代) |

| 顯示記憶體 | 96GB GDDR7 ECC | 96GB GDDR7 ECC |

| 記憶體頻寬 | 1,792 GB/s | 1,792 GB/s |

| 最大功耗 (TGP) | 600W | 300W |

| 官方 FP32 效能 | 125 TFLOPS | 110 TFLOPS |

| 官方 AI TOPS | 4,000 | 3,511 |

| 散熱設計 | 雙風扇(向兩側出風) | 鼓風扇(從卡尾直排出風) |

| 散熱實測(Level1Techs) | 滿載風扇 47%、78°C | 滿載風扇 37%、62°C |

| 適合多卡並排 | 不建議(雙風扇排熱會互相影響) | 是(直排不干擾) |

| 建議 PSU(規劃起點) | 1200W+(單卡)/ 1650W+(雙卡) | 850W+(單卡)/ 1200W+(雙卡) |

可以簡化理解為:Workstation Edition 偏向「單卡最高效能」, Max-Q Workstation Edition 偏向「低功耗與多卡密度」——官方也將 Max-Q 定位為 適合最多 4 卡的密集工作站配置。理解這點,後面所有決策邏輯都會比較清楚。

實測數據:50% 功耗,最多 20% 效能損失

Level1Techs 用 Falcon Northwest 96 核 Threadripper Pro + 512GB RAM 跑了多種工作負載。 數據翻譯成採購語言:

場景 1:LLM 推論(最重要的數據)

DeepSeek distilled 模型(記憶體用量 56-60GB / 96GB):

LLM 推論吞吐

為什麼差距這麼小?因為常見的 LLM 推論工作負載多為 memory-bound(記憶體頻寬瓶頸) 而不是 compute-bound——GPU 核心並沒有滿載,大部分時間是在等記憶體存取。 所以即使核心功耗降一半,效能損失也相對輕微。

場景 2:純計算(Compute-Bound)

Python MAP Finder(Maximum Achievable FLOPs,純運算密集):

峰值計算吞吐(Python MAP Finder)

差距 20–28%。但有個有趣的發現: 把 Workstation 限制在 450W,效能幾乎不掉——意思是 600W 最後那 150W 邊際效益急速下降。

場景 3:Blender 渲染(3D / 影視)

Blender Benchmark

效能差距 ~20%。Blender 是 compute-bound 但有負載變化,差距介於 LLM 與純算之間。

場景 4:遊戲(如果你問)

遊戲效能(4K 高設定)

遊戲是 GPU 滿載最持久的場景,差距最大。但這對 AI 工作站客戶不是關鍵指標, 除非你買來偶而也想打個電動。

結論:差距的「形狀」

把所有數據放在一起看,會發現一個 pattern:

| 工作負載類型 | 300W vs 600W 效能差距 | 原因 |

|---|---|---|

| LLM 推論 / 微調 | 10–18% | Memory-bound,核心沒滿載 |

| 3D 渲染(Blender) | ~20% | 有負載變化 |

| 純運算(FP32 密集) | 20–28% | Compute-bound 滿載 |

| 即時遊戲 / RTX | 33–50% | 持續 100% 滿載 |

規律:工作負載越偏向 memory-bound,Max-Q 的損失越小。 常見的 LLM 推論與部分微調情境多屬此類——這也是 NVIDIA 在這個世代強化 96GB 顯存的核心賣點。但訓練、Compute-bound 微調與 3D 渲染仍會吃滿運算單元, Max-Q 在這些場景的損失較明顯。

整機配置的隱形成本

採購單卡很容易,但選 Workstation 600W 等於連動了整機規格。 我們從接觸過的工作站採購經驗,整理三個常被忽略的成本:

1. 電源 (PSU) 升級

| 配置 | 建議 PSU |

|---|---|

| 單張 Workstation 600W | 1200W 工業級 |

| 兩張 Workstation 600W | 1500W+,要 12V2 雙路供電 |

| 單張 Max-Q 300W | 一般 850W |

| 兩張 Max-Q 300W | 1000–1200W |

雙 Workstation 配置實際上台灣消費級電源很難找到合適選項, 通常要進到企業級電源(如 Zeus 1650R),有些還需要 240V 電壓。 Max-Q 雙卡則大多數高階工作站電源都能應付。

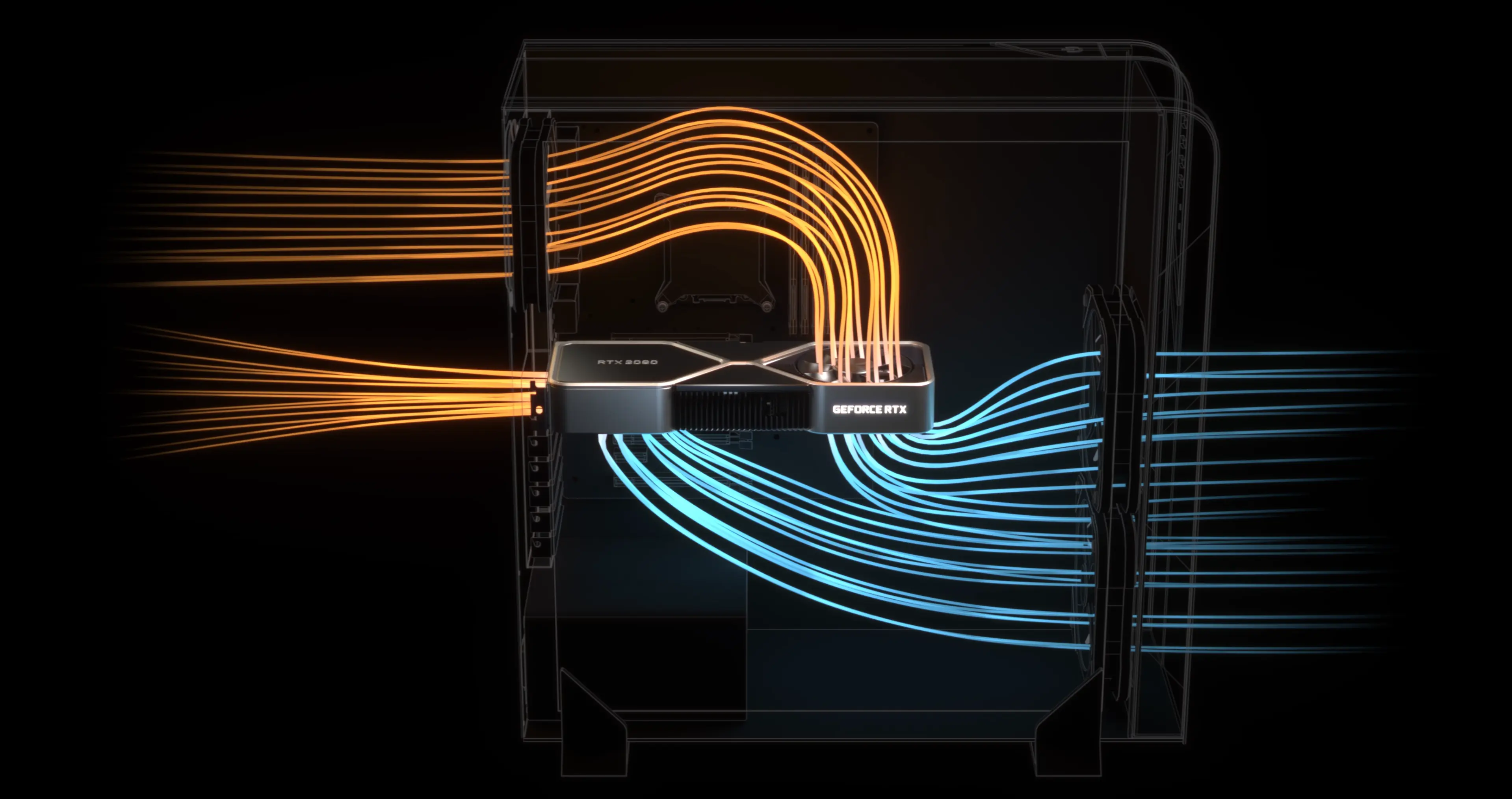

2. 機殼與散熱

Workstation 的雙風扇是向上下吹(類似 GeForce 5090 設計), 兩張並排會互相加熱——上面那張的熱風直接吹到下面那張。 即使機殼通風好,兩張 600W 並排也很考驗散熱設計。

Max-Q 的鼓風扇是從卡尾直排出風,兩張並排互不干擾—— 這就是為什麼 Max-Q 是「多卡相容版」。

3. 噪音與環境

Level1Techs 在機架式機殼測得:

- Workstation 600W 滿載:78°C、風扇 47%

- Max-Q 300W 滿載:62°C、風扇 37%

但 Max-Q 的優勢不是「絕對安靜」,而是功耗低、排熱路徑清楚、適合多卡密集。 單卡放在辦公室桌邊時,實際噪音仍取決於機殼風道、CPU 散熱、風扇曲線—— 空間充足、機殼風道設計良好的單卡 Workstation 也可能有不錯的噪音表現。 這點建議實際試聽再決定。

一個值得注意的限制:多卡互連走 PCIe

目前官方 Workstation / Max-Q 規格表未列 NVLink,多卡配置主要視為走 PCIe 5.0 x16 互連,頻寬遠低於 NVLink。如果你的工作流程是多卡分散式訓練,這會是個限制—— RTX PRO 6000 工作站版本不是設計給訓練 100B+ 模型的叢集用。

如果你要做大規模分散式訓練,看 H200 / B200 等資料中心平台才是對的方向。 RTX PRO 6000 工作站系列的甜蜜點是**「單機高顯存 + 中規模推論 / 微調 / 渲染」**。

採購決策邏輯

依你的主要工作負載走以下流程:

flowchart TD

Start([主要工作負載?]) --> LLM[LLM 推論 / 微調]

Start --> Render[3D 渲染 / Blender]

Start --> Mixed[混合 AI 與渲染]

Start --> Train[多卡訓練 4 卡以上]

LLM --> LLM_Q{96GB 夠用?}

LLM_Q -->|是| MaxQ1[Max-Q]:::recommend

LLM_Q -->|否| MaxQ2[Max-Q × 2]:::recommend

Render --> WS1[Workstation 600W]:::recommend

Mixed --> Mix_Q{AI 占比 > 60%?}

Mix_Q -->|是| MaxQ3[Max-Q]:::recommend

Mix_Q -->|否| WS2[Workstation 600W]:::recommend

Train --> HX[H200 / B200]:::warn

classDef recommend fill:#0D9488,stroke:#0F766E,color:#FFFFFF

classDef warn fill:#FEE2E2,stroke:#DC2626,color:#7F1D1D 圖中精簡後的建議對應更詳細的說明:

- LLM 推論 / 96GB 夠用 → Max-Q:省下的功耗預算與機殼空間,可考慮加配 SSD/RAM

- LLM 推論 / 需更大模型 → Max-Q × 2:共計 192GB VRAM,需推論框架支援模型切分(非統一顯存池)

- 多卡訓練 → H200 / B200:RTX PRO 6000 工作站版沒有 NVLink,跨卡通訊走 PCIe, 不適合大規模分散式訓練

台灣市場與採購

荔枝智慧現貨採購參考價:

| 版本 | 原價 | 荔枝智慧售價 |

|---|---|---|

| Workstation Edition | NT$ 375,000 | NT$ 345,000 |

| Max-Q Workstation Edition | NT$ 365,000 | NT$ 335,000 |

所有版本皆為 NVIDIA 原廠保固 3 年、開立統一發票、量大採購可議價。 依購買管道與時機,價格與供貨會有一定變動,建議直接洽詢取得當期最新報價。

想知道哪款適合你的工作負載?

前往 RTX PRO 6000 商城頁面 或 直接來信詢價, 我們會在 2 個工作日內回覆,依你的應用情境提供配置建議。

參考資料: